في عام 2023، توقفت مجلة الخيال العلمي الأدبية "Clarkesworld" عن قبول المشاركات الجديدة بسبب كثرة المشاركات المُولّدة بواسطة الذكاء الاصطناعي.

وبحسب ما لاحظه المحررون، قام العديد من المُرسلين بنسخ إرشادات المجلة التفصيلية للقصة ولصقها في برنامج ذكاء اصطناعي ثم إرسال النتائج.

ولم تكن هذه المجلة الوحيدة التي تلقت هذه المشاركات، فقد أبلغت مجلات أدبية أخرى عن عدد كبير منها.

هذا مجرد مثال واحد على اتجاه شائع. كان النظام القديم يعتمد على صعوبة الكتابة والإدراك للحد من حجم البيانات. أما الذكاء الاصطناعي التوليدي فيُرهق النظام لأن البشر الذين يتلقون البيانات لا يستطيعون مواكبة ذلك.

هذا يحدث في كل مكان. تغصّ الصحف برسائل القراء التي تُنشئها أنظمة الذكاء الاصطناعي ، وكذلك المجلات الأكاديمية .

ويتلقى المشرّعون سيلاً من تعليقات ناخبيهم التي تُنشئها هذه الأنظمة . وتكتظّ المحاكم حول العالم بالوثائق التي تُنشئها أنظمة الذكاء الاصطناعي، لا سيما من قبل الأشخاص الذيم يمثلون أنفسهم. وتكتظّ مؤتمرات الذكاء الاصطناعي بأوراق بحثية تُنشئها هذه الأنظمة.

وتغصّ وسائل التواصل الاجتماعي بمنشورات الذكاء الاصطناعي.

وفي مجلات الموسيقى، والبرمجيات مفتوحة المصدر، والتعليم، والصحافة الاستقصائية، والتوظيف ، يتكرر المشهد نفسه.

على غرار رد فعل Clarkesworld الأولي، أغلقت بعض هذه المؤسسات عمليات تقديم الأبحاث. بينما واجهت مؤسسات أخرى هجوم الذكاء الاصطناعي بردود فعل دفاعية، غالباً ما تتضمن استخداماً مضاداً للذكاء الاصطناعي.

يستخدم المراجعون الأكاديميون بشكل متزايد الذكاء الاصطناعي لتقييم الأبحاث التي قد تكون مُولّدة بواسطة الذكاء الاصطناعي. وتلجأ منصات التواصل الاجتماعي إلى مشرقي الذكاء الاصطناعي.

وتستخدم الأنظمة القضائية الذكاء الاصطناعي لفرز ومعالجة كميات هائلة من الدعاوى القضائية التي يُعززها الذكاء الاصطناعي. ويلجأ أصحاب العمل إلى أدوات الذكاء الاصطناعي لمراجعة طلبات المرشحين.

ويستخدم المعلمون الذكاء الاصطناعي ليس فقط لتصحيح الأبحاث وإدارة الامتحانات، بل أيضاً كأداة لتقديم التغذية الراجعة للطلاب.

هذه كلها سباقات تسلح: تكرار سريع وتنافسي لتطبيق تقنية مشتركة لأغراض متضاربة. وللعديد من هذه السباقات آثار ضارة واضحة.

فالمجتمع يتضرر إذا ما اكتظت المحاكم بقضايا تافهة مفتعلة بواسطة الذكاء الاصطناعي. كما أن هناك ضرراً إذا ما مُنحت معايير الأداء الأكاديمي المتعارف عليها - كالمنشورات والاستشهادات - للباحثين الأكثر استعداداً لتقديم رسائل وأوراق بحثية مكتوبة بواسطة الذكاء الاصطناعي بطريقة احتيالية، بدلاً من أولئك الذين تُحدث أفكارهم التأثير الأكبر.

ويكمن الخوف في أن السلوك الاحتيالي الذي يُتيحه الذكاء الاصطناعي، في نهاية المطاف، سيقوض الأنظمة والمؤسسات التي يعتمد عليها المجتمع.

إيجابيات الذكاء الاصطناعي

ومع ذلك، فإن بعض سباقات التسلح في مجال الذكاء الاصطناعي هذه لها جوانب إيجابية خفية ومفاجئة، والأمل هو أن تتمكن بعض المؤسسات على الأقل من التغيير بطرق تجعلها أقوى.

يبدو أن العلم سيتعزز بفضل الذكاء الاصطناعي، إلا أنه يواجه مشكلة عندما يرتكب الذكاء الاصطناعي أخطاءً. ولنأخذ مثالاً على ذلك الصياغات غير المنطقية التي يولدها الذكاء الاصطناعي والتي تتسرب إلى الأوراق العلمية.

قد يكون استخدام العلماء للذكاء الاصطناعي للمساعدة في كتابة الأبحاث الأكاديمية أمرًا إيجابيًا، شريطة استخدامه بحذر وشفافية.

يُعدّ الذكاء الاصطناعي أداةً أساسيةً في البحث العلمي، حيث يُستخدم لمراجعة الأدبيات، والبرمجة، وتشفير البيانات وتحليلها.

وبالنسبة للكثيرين، أصبح دعمًا بالغ الأهمية للتعبير والتواصل العلمي. قبل ظهور الذكاء الاصطناعي، كان بإمكان الباحثين ذوي التمويل الأفضل توظيف مساعدين بشريين لكتابة أبحاثهم الأكاديمية.

بالنسبة للعديد من المؤلفين الذين لا يتحدثون الإنجليزية كلغة أولى، كان توظيف هذا النوع من المساعدة ضرورةً مكلفة. أما اليوم، فيُتيح الذكاء الاصطناعي هذه الخدمة للجميع.

في مجال الأدب، تُلحق الأعمال المُولّدة بواسطة الذكاء الاصطناعي، والتي تُقدّم بطريقة احتيالية، ضرراً بالغاً بالمؤلفين البشريين الذين باتوا يواجهون منافسة متزايدة، وبالقراء الذين قد يشعرون بالخداع بعد قراءة عملٍ من تأليف آلة دون علمهم.

مع ذلك، قد ترحب بعض دور النشر بالطلبات المُقدّمة بمساعدة الذكاء الاصطناعي، شريطة الإفصاح المناسب عنها واتباع إرشادات محددة، وتستفيد من الذكاء الاصطناعي لتقييمها وفقاً لمعايير مثل الأصالة والملاءمة والجودة.

قد يرفض البعض الأعمال المُولّدة بواسطة الذكاء الاصطناعي، لكن هذا سيُكلّفهم ثمناً باهظاً. فمن غير المرجح أن يتمكن أي محرر بشري أو تقنية من التمييز بين الكتابة البشرية والآلية. لذا، ستحتاج دور النشر التي ترغب في نشر أعمال بشرية حصراً إلى حصر المشاركات بمجموعة من المؤلفين الذين تثق بهم لعدم استخدامهم الذكاء الاصطناعي.

وإذا كانت هذه السياسات شفافة، فسيتمكن القراء من اختيار الصيغة التي يفضلونها والاستمتاع بالقراءة من أيٍّ من النوعين أو كليهما.

لا نرى أي مشكلة في استخدام الباحثين عن عمل للذكاء الاصطناعي لتحسين سيرهم الذاتية أو كتابة رسائل تعريفية أفضل: فالأثرياء وأصحاب الامتيازات لطالما تمتعوا بإمكانية الاستعانة بمساعدة بشرية في هذه الأمور.

لكن الأمر يتجاوز الحدود عندما يُستخدم الذكاء الاصطناعي للكذب بشأن الهوية والخبرة، أو للغش في مقابلات العمل.

وبالمثل، تتطلب الديمقراطية أن يتمكن مواطنوها من التعبير عن آرائهم لممثليهم، أو فيما بينهم عبر وسيلة إعلامية كالصحف.

لطالما استطاع الأثرياء وأصحاب النفوذ توظيف كتّاب لتحويل أفكارهم إلى نصوص مقنعة، ونرى أن توفير الذكاء الاصطناعي لهذه المساعدة لعدد أكبر من الناس أمر إيجابي. لكن في هذا السياق، قد تكون أخطاء الذكاء الاصطناعي وتحيزاته ضارة.

فربما يستخدم المواطنون الذكاء الاصطناعي لأكثر من مجرد اختصار لتوفير الوقت؛ إذ قد يُسهم في تعزيز معارفهم وقدراتهم، وإصدار بيانات حول عوامل تاريخية أو قانونية أو سياسية لا يُتوقع منهم التحقق منها بشكل مستقل.

معزز الاحتيال

ما لا نريده هو أن يستخدم جماعات الضغط الذكاء الاصطناعي في حملات تضليلية، بكتابة رسائل متعددة وعرضها على أنها آراء شخصية. هذه مشكلة قديمة أيضاً، وقد زاد الذكاء الاصطناعي من حدتها.

ما يُميّز الجانب الإيجابي عن السلبي هنا ليس أي جانب جوهري في التكنولوجيا، بل ديناميكية القوة. فالتكنولوجيا نفسها التي تُسهّل على المواطن مشاركة تجربته الحياتية مع مشرّعه، تُمكّن في الوقت نفسه الشركات من تحريف الرأي العام على نطاق واسع.

الأول تطبيقٌ للذكاء الاصطناعي يُحقق توازنًا في القوة، ويعزز الديمقراطية التشاركية؛ أما الثاني فهو تطبيقٌ يُركّز القوة، ويُهددها.

بشكل عام، نعتقد أن المساعدة في الكتابة والإدراك، التي كانت حكرًا على الأثرياء وأصحاب النفوذ لفترة طويلة، يجب أن تكون متاحة للجميع. تكمن المشكلة في أن الذكاء الاصطناعي يُسهّل عمليات الاحتيال.

لذا، يجب أن يوازن أي رد فعل بين تبني هذا التوسع الجديد في إمكانية الوصول إلى هذه التقنيات وبين منع الاحتيال.

لا سبيل لإيقاف هذه التقنية. فالذكاء الاصطناعي عالي الكفاءة متوفر على نطاق واسع ويمكن تشغيله على أجهزة الكمبيوتر المحمولة. قد تساعد المبادئ التوجيهية الأخلاقية والحدود المهنية الواضحة - لمن يعملون بحسن نية.

لكن لن يكون هناك سبيل لمنع الكتّاب الأكاديميين أو الباحثين عن عمل أو المواطنين تمامًا من استخدام هذه الأدوات، سواءً للمساعدة المشروعة أو لارتكاب الاحتيال.

وهذا يعني المزيد من التعليقات والرسائل والطلبات والمشاركات.

تكمن المشكلة في أن من يتلقى هذا السيل الجارف من المعلومات المدعومة بالذكاء الاصطناعي لا يستطيع التعامل مع حجمها المتزايد.

والحل يكمن في تطوير أدوات ذكاء اصطناعي مساعدة تُفيد المؤسسات والمجتمع، مع الحدّ من الاحتيال في الوقت نفسه.

وقد يعني ذلك تبني استخدام الذكاء الاصطناعي في هذه الأنظمة المعادية، حتى وإن لم يتمكن الذكاء الاصطناعي الدفاعي من تحقيق التفوق المطلق.

الموازنة بين الأضرار والفوائد

يُعاني مجتمع الخيال العلمي من تحديات الذكاء الاصطناعي منذ عام 2023. وقد أعادت منصة Clarkesworld فتح باب التقديم، مُدعيةً امتلاكها آليةً فعّالةً للفصل بين القصص المكتوبة بواسطة البشر وتلك المكتوبة بواسطة الذكاء الاصطناعي. ولا أحد يعلم إلى متى، أو مدى فعالية هذه الآلية.

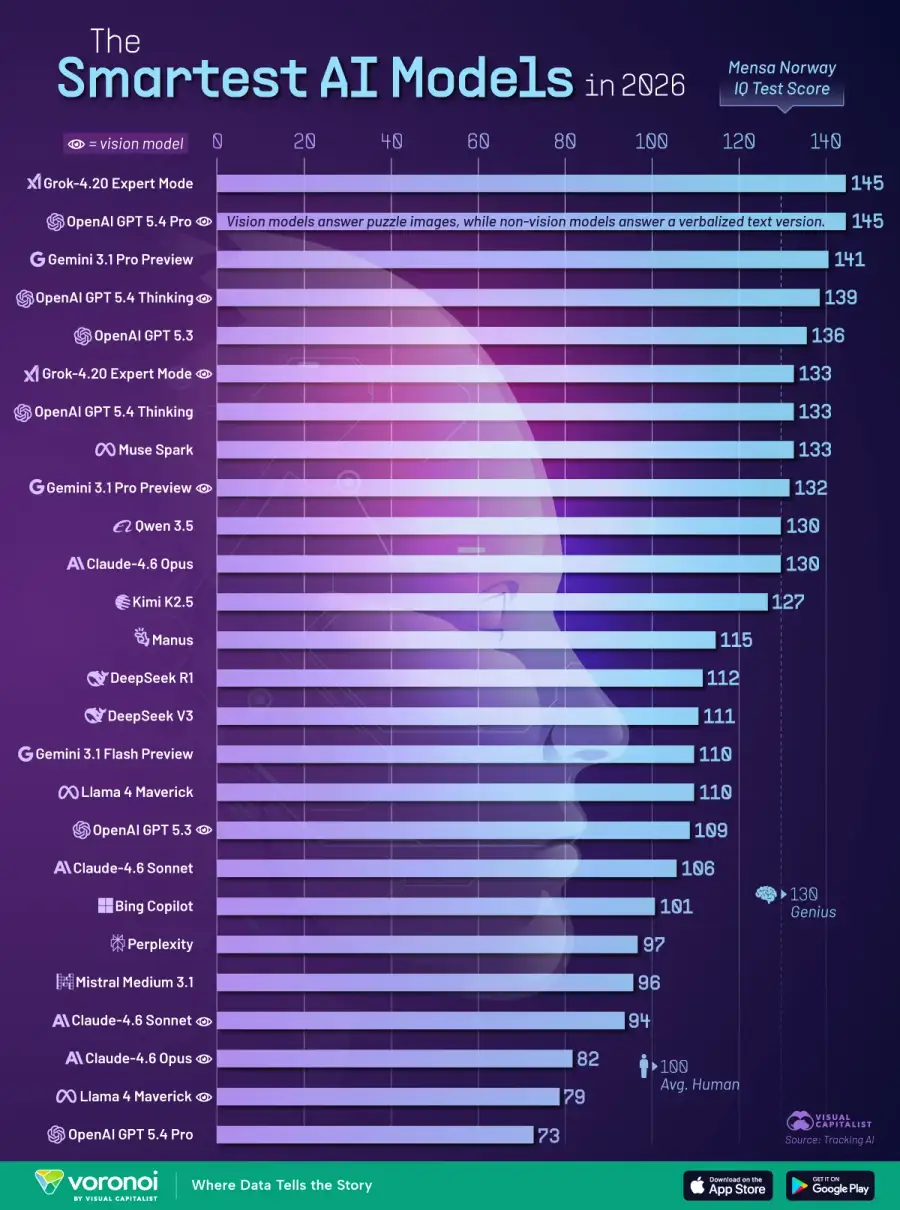

سباق التسلح مستمر. لا توجد طريقة سهلة لتحديد ما إذا كانت فوائد الذكاء الاصطناعي المحتملة ستفوق أضراره، الآن أو في المستقبل.

ولكن كمجتمع، يمكننا التأثير على توازن الأضرار التي يُسببها والفرص التي يُتيحها بينما نشق طريقنا في خضم المشهد التكنولوجي المتغير.