حوار حصري مع كبير علماء شركة OpenAI، Jakub Pachocki، حول التحدي الكبير الجديد لشركته ومستقبل الذكاء الاصطناعي.

تعيد شركة OpenAI تركيز جهودها البحثية وتُوجّه مواردها نحو تحدٍّ جديدٍ كبير. فقد وضعت الشركة، التي تتخذ من سان فرانسيسكو مقرًا لها، نصب عينيها بناء ما تُسمّيه "باحث الذكاء الاصطناعي"، وهو نظام آلي بالكامل قائم على الوكلاء، قادر على معالجة المشكلات الكبيرة والمعقدة بمفرده. وتؤكد OpenAI أن هذا الهدف البحثي الجديد سيكون بمثابة "نجمها الهادي" خلال السنوات القليلة المقبلة، جامعًا بين مسارات بحثية متعددة، تشمل العمل على نماذج الاستدلال، والوكلاء، وقابلية التفسير .

بل إن هناك جدولًا زمنيًا. تخطط OpenAI لبناء "باحث ذكاء اصطناعي متدرب مستقل" - وهو نظام قادر على معالجة عدد محدود من المشكلات البحثية المحددة بمفرده - بحلول شهر سبتمبر.

سيكون هذا الباحث المتدرب بمثابة مقدمة لنظام بحثي متعدد العوامل مؤتمت بالكامل، والذي تخطط الشركة لإطلاقه في عام 2028.

وتقول OpenAI إن هذا الباحث في مجال الذكاء الاصطناعي سيكون قادرًا على معالجة المشكلات التي تفوق قدرة البشر على التعامل معها، سواءً من حيث الحجم أو التعقيد.

قد تتعلق هذه المهام بالرياضيات والفيزياء، مثل ابتكار براهين أو فرضيات جديدة، أو بعلوم الحياة كعلم الأحياء والكيمياء، أو حتى بمعضلات الأعمال والسياسة. نظرياً، يمكنك استخدام هذه الأداة لأي نوع من المشكلات التي يمكن صياغتها نصياً أو برمجياً أو حتى كتابياً على السبورة البيضاء، وهو ما يشمل نطاقاً واسعاً.

لطالما كانت OpenAI رائدة في مجال الذكاء الاصطناعي لسنوات. وقد ساهمت هييمنتها المبكرة على نماذج اللغة الضخمة في تشكيل التكنولوجيا التي يستخدمها مئات الملايين من الناس يوميًا.

لكنها تواجه الآن منافسة شرسة من شركات بناء النماذج المنافسة مثل Anthropic وGoogle DeepMind. إن ما ستُطوّره OpenAI لاحقًا أمرٌ بالغ الأهمية، سواءً بالنسبة لها أو لمستقبل الذكاء الاصطناعي.

يقع جزء كبير من هذا القرار على عاتق جاكوب باتشوكي، كبير علماء شركةOpenAI، الذي يحدد أهداف الشركة البحثية طويلة الأجل.

وقد لعب باتشوكي أدوارًا رئيسية في تطوير كل منGPT-4، وهو نموذج لغة متعلمة ثوري تم إصداره في عام 2023، وما يسمى بنماذج الاستدلال، وهي تقنية ظهرت لأول مرة في عام 2024 وتدعم الآن جميع برامج الدردشة الآلية الرئيسية والأنظمة القائمة على الوكلاء.

في مقابلة حصرية هذا الأسبوع، شرح لي باتشوكي أحدث رؤية لشركة OpenAI. يقول: "أعتقد أننا نقترب من مرحلة سنمتلك فيها نماذج قادرة على العمل بشكل متواصل ومتسق تمامًا كما يفعل البشر.

بالطبع، لا يزال من الضروري وجود أشخاص مسؤولين يحددون الأهداف. لكنني أعتقد أننا سنصل إلى مرحلة يكون لدينا فيها مختبر أبحاث متكامل في مركز بيانات."

حل المشكلات الصعبة

ليست هذه الادعاءات الكبيرة بجديدة. فمهمة إنقاذ العالم بحلّ أصعب مشاكله هي المهمة المعلنة لجميع شركات الذكاء الاصطناعي الرائدة. أخبرني ديميس هاسابيس في عام ٢٠٢٢ أن هذا هو سبب تأسيسه لشركة ديب مايند.

ويقول داريو أمودي، الرئيس التنفيذي لشركة أنثروبيك، إنه يبني ما يُشبه دولة من العباقرة في مركز بيانات.

أما سام ألتمان، رئيس باتشوكي، فيريد علاج السرطان.

لكن باتشوكي يقول إن شركة أوبن إيه آي تمتلك الآن معظم ما تحتاجه لتحقيق ذلك.

في يناير، أطلقت OpenAI تطبيق Codex، وهو تطبيق قائم على الذكاء الاصطناعي، قادر على تشغيل التعليمات البرمجية فورًا لتنفيذ مهام على جهاز الكمبيوتر.

يستطيع التطبيق تحليل المستندات، وإنشاء الرسوم البيانية، وإعداد ملخص يومي لبريدك الوارد وحساباتك على مواقع التواصل الاجتماعي، وغير ذلك الكثير. (أصدرت شركات أخرى أدوات مماثلة، مثل Claude Code وClaude Cowork من Anthropic).

تزعم شركة OpenAI أن معظم موظفيها التقنيين يستخدمون الآن منصة Codex في عملهم.

ويقول باتشوكي: "يمكن اعتبار Codex بمثابة نسخة مبكرة جدًا من باحث الذكاء الاصطناعي، وأتوقع أن تتحسن Codex بشكل جذري".

يكمن الحل في تصميم نظام قادر على العمل لفترات أطول، مع تقليل التدخل البشري. يقول باتشوكي: "ما نبحث عنه فعلاً في نظام البحث الآلي المتدرب هو نظام يمكن تفويض المهام إليه، وهي مهام تستغرق من الشخص العادي بضعة أيام".

يقول دوغ داوني، الباحث العلمي في معهد ألين للذكاء الاصطناعي، والذي لا تربطه صلة بشركة OpenAI: "هناك الكثير من الأشخاص المتحمسين لبناء أنظمة قادرة على إجراء بحوث علمية طويلة الأمد.

أعتقد أن هذا الحماس نابعٌ إلى حد كبير من نجاح هذه البرامج البرمجية. إن إمكانية تفويض مهام برمجية ضخمة لأدوات مثل Codex أمرٌ في غاية الأهمية والإبهار. وهذا يطرح السؤال: هل يمكننا القيام بأمور مماثلة خارج نطاق البرمجة، في مجالات علمية أوسع؟"

بالنسبة لباتشوكي، الإجابة هي نعم بكل تأكيد . في الواقع، يعتقد أن الأمر لا يعدو كونه مسألة مواصلة التقدم على المسار الذي نسلكه بالفعل.

ويقول إن مجرد تحسين القدرات الشاملة يؤدي إلى نماذج قادرة على العمل لفترات أطول دون مساعدة. ويشير إلى القفزة النوعية التي حققها نموذج GPT-3 في عام 2020 إلى نموذج GPT-4 في عام 2023، وهما نموذجان سابقان من نماذج OpenAI. ويضيف أن GPT-4 كان قادراً على العمل على مشكلة ما لفترة أطول بكثير من سابقه، حتى بدون تدريب متخصص.

أحدثت ما يُسمى بنماذج الاستدلال نقلة نوعية أخرى. وقد ساهم تدريب نماذج التعلم الآلي على حل المشكلات خطوة بخطوة، والتراجع عند ارتكاب خطأ أو الوصول إلى طريق مسدود، في تحسين أداء هذه النماذج لفترات أطول. ويؤمن باتشوكي بأن نماذج الاستدلال لدى OpenAI ستواصل التحسن.

لكن OpenAI تقوم أيضًا بتدريب أنظمتها على العمل بمفردها لفترة أطول من خلال تزويدها بعينات محددة من المهام المعقدة، مثل الألغاز الصعبة المأخوذة من مسابقات الرياضيات والبرمجة، مما يجبر النماذج على تعلم كيفية القيام بأشياء مثل تتبع أجزاء كبيرة جدًا من النصوص وتقسيم المشكلات إلى مهام فرعية متعددة (ثم إدارتها).

ليس الهدف بناء نماذج تفوز فقط في مسابقات الرياضيات. يقول باتشوكي: "هذا يسمح لك بإثبات فعالية التكنولوجيا قبل ربطها بالواقع. لو أردنا حقًا، لكان بإمكاننا بناء عالم رياضيات آلي مذهل. لدينا جميع الأدوات، وأعتقد أن الأمر سيكون سهلاً نسبيًا. لكنه ليس من أولوياتنا الآن، لأنه كما تعلم، عندما تؤمن بقدرتك على إنجازه، هناك أمور أكثر إلحاحًا بكثير يجب القيام بها."

ويضيف: "نحن نركز الآن بشكل أكبر على الأبحاث ذات الصلة بالواقع".

يعني هذا حاليًا الاستفادة من إمكانيات Codex في مجال البرمجة ومحاولة تطبيقها على حل المشكلات بشكل عام. يقول: "هناك تغيير كبير يحدث، خاصة في مجال البرمجة. وظائفنا الآن مختلفة تمامًا عما كانت عليه قبل عام واحد فقط. لم يعد أحد يقوم بتحرير الشفرة البرمجية باستمرار. بدلًا من ذلك، أنت تدير مجموعة من وكلاء Codex." إذا كان Codex قادرًا على حل مشكلات البرمجة (كما يُقال)، فبإمكانه حل أي مشكلة.

الخط يرتفع دائماً

صحيح أن شركة OpenAI حققت بعض النجاحات اللافتة في الأشهر القليلة الماضية. فقد استخدم الباحثون GPT-5 (نموذج التعلم الآلي الذي يدعم Codex) لاكتشاف حلول جديدة لعدد من المسائل الرياضية التي لم تُحل، وتجاوز العقبات التي بدت واضحة في عدد من ألغاز علم الأحياء والكيمياء والفيزياء.

يقول باتشوكي: "إن مجرد النظر إلى هذه النماذج التي تتوصل إلى أفكار تستغرق معظم أسابيع الدكتوراه على الأقل، يجعلني أتوقع أننا سنشهد تسارعًا أكبر بكثير قادمًا من هذه التكنولوجيا في المستقبل القريب".

لكن باتشوكي يُقرّ بأن الأمر لم يُحسم بعد. كما أنه يتفهم سبب استمرار بعض الناس في التشكيك في مدى تأثير هذه التقنية على تغيير قواعد اللعبة. ويعتقد أن الأمر يعتمد على أسلوب العمل الذي يُفضّله الناس وما يحتاجون إلى القيام به. ويقول: "أُصدّق أن بعض الناس لا يجدونها مفيدة للغاية حتى الآن".

يخبرني أنه لم يكن يستخدم حتى خاصية الإكمال التلقائي – وهي أبسط نسخة من تقنية البرؤمجة التوليدية -قبل عام. يقول: "أنا دقيق جدًا في كتابة الكود.

أفضل كتابة كل شيء يدويًا في محرر النصوص Vim كلما أمكنني ذلك." (Vim هو محرر نصوص يفضله العديد من المبرمجين المحترفين، ويتم التفاعل معه عبر عشرات اختصارات لوحة المفاتيح بدلًا من الفأرة).

لكن ذلك تغير عندما رأى إمكانيات أحدث النماذج. لا يزال يرفض تسليم مهام التصميم المعقدة، لكنها توفر الوقت عندما يريد فقط تجربة بعض الأفكار. يقول: "يمكنني الآن تشغيل التجارب في عطلة نهاية أسبوع، بينما كان يستغرق مني كتابة الكود أسبوعًا كاملًا في السابق".

ويضيف: "لا أعتقد أنه وصل إلى المستوى الذي يسمح لي بتركه يتولى زمام الأمور ويصمم كل شيء. ولكن بمجرد أن تراه يقوم بشيء يستغرق أسبوعًا لإنجازه، أعني، يصعب الاعتراض على ذلك".

تتمثل خطة باتشوكي في تعزيز قدرات حل المشكلات الحالية التي تمتلكها أدوات مثل Codex وتطبيقها في جميع العلوم.

يوافق داوني على أن فكرة الباحث الآلي رائعة للغاية: "سيكون من المثير للاهتمام أن نعود غداً صباحاً ونجد أن الوكيل قد أنجز الكثير من العمل وهناك نتائج جديدة يمكننا فحصها"، كما يقول.

لكنه يحذر من أن بناء مثل هذا النظام قد يكون أصعب مما يصوره باتشوكي. في الصيف الماضي، اختبر داوني وزملاؤه العديد من نماذج التعلم الآلي المتقدمة على مجموعة من المهام العلمية. وقد تفوق أحدث نموذج من OpenAI، وهو GPT-5، ولكنه مع ذلك ارتكب الكثير من الأخطاء.

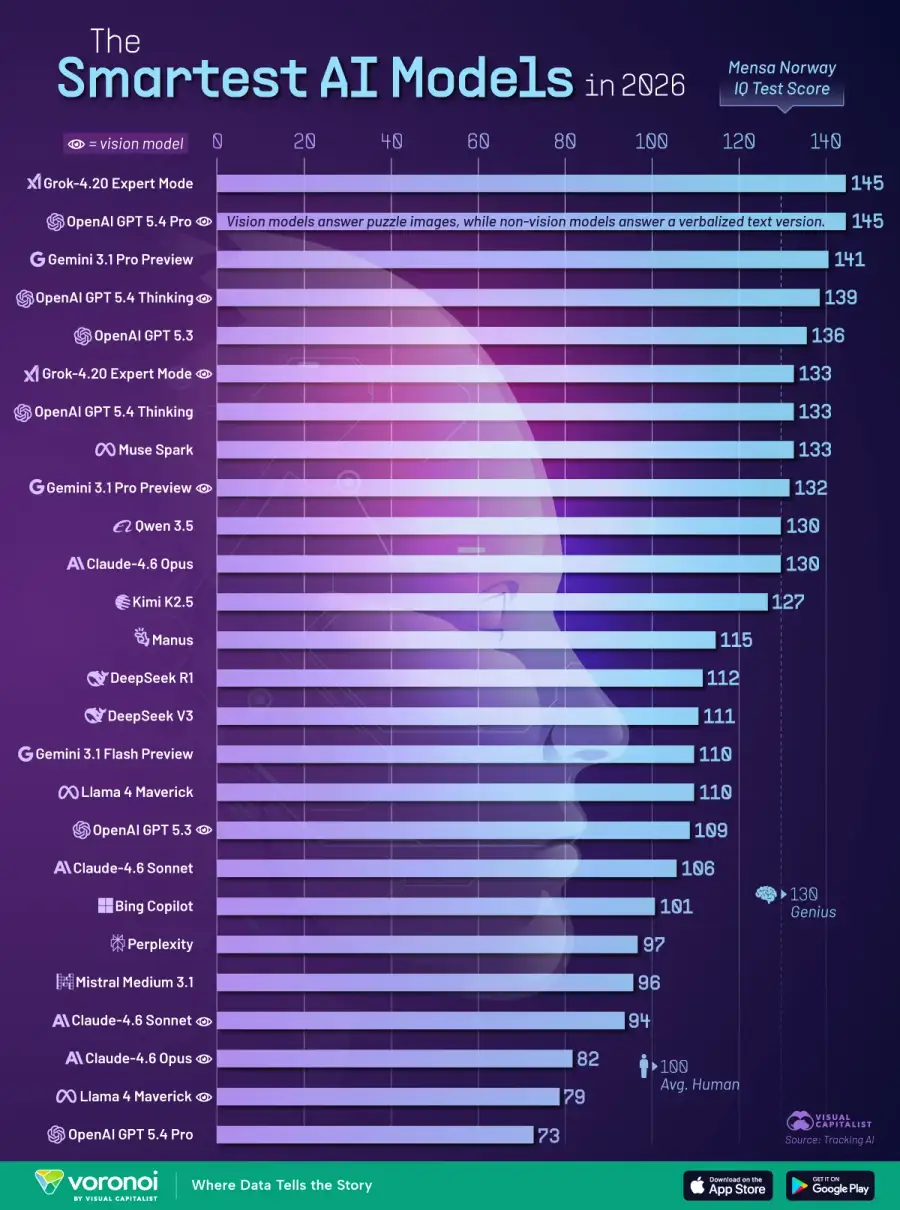

يقول: "إذا اضطررتَ إلى ربط المهام ببعضها، فإن احتمالية إنجاز عدة مهام منها بشكل صحيح على التوالي تقل". ويقر داوني بأن الأمور تتطور بسرعة، وأنه لم يختبر أحدث إصدارات GPT-5 (أصدرت OpenAI الإصدار GPT-5.4 قبل أسبوعين). ويضيف: "لذا قد تكون تلك النتائج قديمة بالفعل".

أسئلة جدية بلا إجابات

سألتُ باتشوكي عن المخاطر التي قد تصاحب نظاماً قادراً على حلّ مشاكل كبيرة ومعقدة بمفرده مع إشراف بشري محدود. يقول باتشوكي إنّ العاملين في OpenAI يتحدثون عن هذه المخاطر باستمرار.

قال لي: "إذا كنت تعتقد أن الذكاء الاصطناعي على وشك تسريع الأبحاث بشكل كبير، بما في ذلك أبحاث الذكاء الاصطناعي، فهذا تغيير جذري في العالم. إنه أمر بالغ الأهمية. لكن هذا الأمر يثير تساؤلات جدية لم تُجب بعد. إذا كان بهذه الذكاء والقدرة، وإذا كان بإمكانه إدارة برنامج بحثي كامل، فماذا لو تسبب في شيء سيء؟"

يرى باتشوكي أن ذلك قد يحدث بعدة طرق. قد ينحرف النظام عن مساره. قد يتعرض للاختراق. أو قد يسيء فهم التعليمات ببساطة.

أفضل تقنية لدى OpenAI حاليًا لمعالجة هذه المخاوف هي تدريب نماذج الاستدلال الخاصة بها على مشاركة تفاصيل حول ما تقوم به أثناء عملها. يُعرف هذا النهج لمراقبة نماذج التعلم الموجه بالتعلم باسم مراقبة سلسلة الأفكار.

باختصار، يتم تدريب نماذج التعلم الآلي على تدوين ملاحظات حول ما تقوم به في نوع من المسودات أثناء تنفيذها للمهام. ويمكن للباحثين بعد ذلك استخدام هذه الملاحظات للتأكد من أن النموذج يتصرف كما هو متوقع. وقد نشرت OpenAI أمس تفاصيل جديدة حول كيفية استخدامها لمراقبة تسلسل الأفكار داخلياً لدراسة Codex.

يقول باتشوكي: "بمجرد أن نصل إلى أنظمة تعمل بشكل مستقل إلى حد كبير لفترة طويلة في مركز بيانات كبير، أعتقد أن هذا سيكون شيئًا سنعتمد عليه حقًا".

تتمثل الفكرة في مراقبة دفاتر ملاحظات باحث الذكاء الاصطناعي باستخدام نماذج التعلم الآلي الأخرى، ورصد السلوك غير المرغوب فيه قبل أن يتحول إلى مشكلة، بدلاً من محاولة منع حدوث هذا السلوك السيئ من الأساس. لا تزال نماذج التعلم الآلي غير مفهومة بشكل كافٍ يسمح لنا بالتحكم بها بشكل كامل.

يقول: "أعتقد أن الأمر سيستغرق وقتاً طويلاً قبل أن نتمكن من القول فعلاً: حسناً، لقد حُلّت هذه المشكلة". ويضيف: "إلى أن نثق تماماً بالأنظمة، من الضروري بالتأكيد وضع قيود عليها". ويرى باتشوكي أنه ينبغي نشر النماذج فائقة القوة في بيئات معزولة، بمعزل عن أي شيء قد يُعطّلها أو يُستخدم لإلحاق الضرر.

استُخدمت أدوات الذكاء الاصطناعي بالفعل لابتكار هجمات إلكترونية جديدة. ويخشى البعض من استخدامها لتصميم مسببات أمراض اصطناعية يمكن استخدامها كأسلحة بيولوجية.

ويمكن إضافة العديد من قصص الرعب المتعلقة بالعلماء الأشرار هنا. يقول باتشوكي: "أعتقد بالتأكيد أن هناك سيناريوهات مقلقة يمكننا تخيلها".

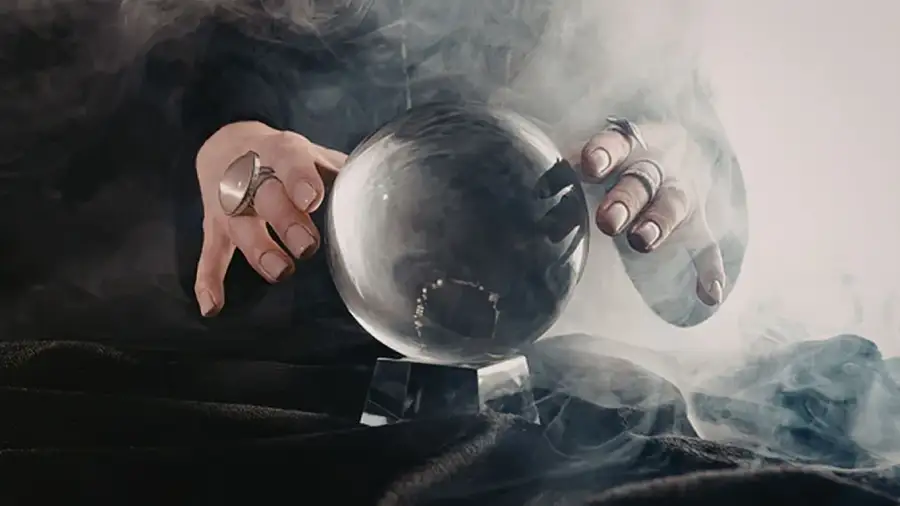

يقول باتشوكي: "سيكون الأمر غريباً للغاية. إنها قوة مركزة بشكل هائل وغير مسبوقة من بعض النواحي.

تخيل أنك تصل إلى عالم يمتلك مركز بيانات قادر على القيام بكل العمل الذي تقوم به OpenAI أو Google. أشياء كانت تتطلب في الماضي مؤسسات بشرية ضخمة، سينجزها الآن بضعة أشخاص فقط."

ويضيف: "أعتقد أن هذا يمثل تحدياً كبيراً أمام الحكومات لإيجاد حل له".

ومع ذلك، يرى البعض أن الحكومات جزء من المشكلة.

. فالحكومة الأمريكية، على سبيل المثال، ترغب في استخدام الذكاء الاصطناعي في ساحة المعركة.

وقد كشف الخلاف الأخير بين شركة أنثروبيك ووزارة الدفاع الأمريكية (البنتاغون) عن وجود اختلاف كبير في وجهات النظر المجتمعية حول حدود استخدام هذه التقنية، ناهيك عن الجهة المسؤولة عن تحديدها. وفي أعقاب هذا الخلاف مباشرة، سارعة شركة OpenAI الى توقيع اتفاقية مع البنتاغون بدلاً من منافستها. ولا يزال الوضع غامضاً.

ضغطتُ على باتشوكي بشأن هذا الأمر. هل يثق حقًا في قدرة الآخرين على إيجاد الحل، أم أنه، بصفته أحد أبرز مهندسي المستقبل، يشعر بمسؤولية شخصية؟ يقول: "أشعر بمسؤولية شخصية. لكنني لا أعتقد أن شركة OpenAI وحدها قادرة على حل هذه المشكلة، من خلال الترويج لتقنيتها بطريقة معينة أو تصميم منتجاتها بطريقة محددة. سنحتاج بالتأكيد إلى مشاركة فعّالة من صانعي السياسات."

إلى أين يقودنا هذا؟ هل نحن حقاً على الطريق الصحيح نحو نوع الذكاء الاصطناعي الذي يتصوره باتشوكي؟ عندما سألت داوني من معهد ألين، ضحك. قال: "لقد عملت في هذا المجال لعقدين من الزمن، ولم أعد أثق بتوقعاتي بشأن مدى قرب أو بعد قدرات معينة".

تتمثل مهمة OpenAI المعلنة في ضمان استفادة البشرية جمعاء من الذكاء الاصطناعي العام (وهي تقنية مستقبلية افتراضية يعتقد العديد من مؤيدي الذكاء الاصطناعي أنها ستكون قادرة على منافسة البشر في معظم المهام المعرفية). وتسعى OpenAI إلى تحقيق ذلك من خلال كونها السبّاقة في تطويره. ولكن في المرة الوحيدة التي ذكر فيها باتشوكي الذكاء الاصطناعي العام خلال حديثنا، سارع إلى توضيح ما يقصده بالحديث عن "تقنية تُحدث تحولاً اقتصادياً جذرياً".

ويقول إن أدمغة LLM ليست مثل أدمغة البشر: "إنها تشبه البشر ظاهرياً في بعض النواحي لأنها مدربة في الغالب على التحدث مع الناس. لكنها لم تتشكل بفعل التطور لتكون فعالة حقاً."

"حتى بحلول عام 2028، لا أتوقع أن نصل إلى أنظمة ذكية تضاهي ذكاء البشر في جميع الجوانب. لا أعتقد أن ذلك سيحدث"، يضيف. "لكنني لا أعتقد أنه ضروري بالضرورة. الأمر المثير للاهتمام هو أنك لست بحاجة إلى أن تكون ذكيًا مثل البشر في جميع جوانبهم لكي تُحدث تغييرًا جذريًا.